Transparência Digital: Relatório META 2024 um diálogo possível com a decisão do STF

O Conselho de Supervisão publicou seu Relatório Anual de 2024, destacando o impacto do órgão na promoção da responsabilidade das plataformas, na proteção da liberdade de expressão e na condução de mudanças nas políticas e práticas da Meta durante o maior ano eleitoral da história moderna.

Relatório 2024 – Moderação e Responsabilidade nas Plataformas da Meta

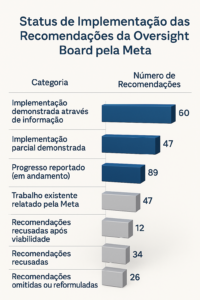

Em todos os trimestres de 2024, a Meta aceitou e implementou mais recomendações do Conselho do que rejeitou, alcançando uma taxa de implementação de 74% entre mais de 300 recomendações emitidas desde 2021. Para acessar a integra do relatório: CLIQUE

Em resposta às recomendações do Conselho, a Meta:

Iniciou em maio de 2024 a rotulagem de conteúdos criados ou alterados por inteligência artificial em suas plataformas. Apenas em outubro de 2024, ao longo de 29 dias, os usuários visualizaram 690 milhões de conteúdos rotulados dessa forma no Facebook e Instagram, recebendo contexto adicional sobre a origem dessas publicações.

Implementou uma iniciativa educativa como alternativa à aplicação de penalidades em contas, para algumas violações iniciais. Essa medida oferece aos usuários a oportunidade de compreender por que seus conteúdos violaram as diretrizes. Três milhões de usuários participaram do exercício educativo, com uma taxa de conclusão superior a 80%, evitando assim restrições em suas contas.

Aumentou a taxa de resolução de casos após escalonamento, passando de 69% para 81% dentro de um período de cinco dias, por meio do trabalho com Trusted Partners – uma rede composta por ONGs, agências humanitárias e pesquisadores de direitos humanos de 113 países. Essa parceria é fundamental para identificar danos emergentes e casos complexos no Facebook, Instagram e Threads.

Essas ações refletem avanços significativos na governança digital, conciliando a moderação responsável com a proteção dos direitos dos usuários em ambientes digitais amplamente utilizados globalmente.

Como a Meta responde a conteúdos sensíveis e ilícitos além do Poder Judiciário

Com base no Relatório Anual 2024 da Meta e do Conselho de Supervisão, seguem detalhes específicos sobre a implementação das recomendações relacionadas a discurso de ódio, conteúdos graves (como pedofilia, atentados ao Estado Democrático de Direito) e a responsabilização das plataformas:

Implementação das Recomendações sobre Discurso de Ódio e Conteúdos Graves

A Meta realizou uma auditoria das suas listas de termos ofensivos (“slur lists”) em 22 países com eleições em 2024, visando melhorar a acurácia da aplicação da sua regra de Conduta Odiosa (Hateful Conduct rule), o que inclui discurso de ódio racial, religioso, de gênero e contra mulheres. Essa medida ajuda a reduzir erros no bloqueio excessivo ou insuficiente desse tipo de conteúdo.

A política de Organizações e Indivíduos Perigosos foi ajustada para permitir mais liberdade de expressão em certos contextos, como o uso do termo “shaheed” (mártir), encerrando uma proibição irrestrita sobre a palavra, refletindo maior nuance no tratamento de discursos sensíveis nesse âmbito.

Meta intensificou a remoção de conteúdos relacionados a violações graves, como pornografia infantil, crimes sexuais contra menores ou pessoas vulneráveis, terrorismo, e incitação ao suicídio ou automutilação, conforme padrões das Diretrizes Comunitárias e recomendações da Supervisão para cumprimento legal e proteção de direitos humanos.

Responsabilização sem Decisão Judicial

A Meta pode ser responsabilizada pela presença de conteúdos ilícitos quando esses são identificados e não removidos adequadamente, mesmo sem ordem judicial direta, especialmente em casos de conteúdos graves.

A notificação extrajudicial por parte de autoridades ou entidades especializadas pode impulsionar a remoção e a responsabilização da plataforma.

Conteúdos que são impulsionados ou pagos por meio dos algoritmos da plataforma recebem atenção especial, pois a amplificação pode aumentar o dano.

Métodos de moderação foram aprimorados para tratar desses conteúdos de forma rigorosa, equilibrando a necessidade de combate ao dano e a proteção à expressão legítima.

Processos e Melhoria de Moderação

Usuários que cometem uma primeira violação de políticas elegíveis (excluindo violações graves como pornografia infantil, drogas de alto risco ou glorificação de organizações perigosas) têm a chance de evitar uma sanção formal ao completar um exercício educativo, promovendo educação em vez de punição institucionalizada desde a primeira infração.

tatus de Implementação das Recomendações da Oversight Board pela Meta

O trabalho colaborativo com Parceiros Confiáveis (Trusted Partners), vale dizer, ONGs, agências humanitárias e pesquisadores de direitos humanos em 113 países, permite identificar e agir rapidamente em escaladas de conteúdo prejudicial, aumentando a taxa de resolução em cinco dias de 69% para 81% entre 2022 e 2024, mesmo com crescimento de quatro vezes no volume de casos recebidos.

Contexto Legal e Governança

O Conselho de Supervisão opera de forma independente da Meta para garantir que as decisões e recomendações sejam baseadas em direitos humanos e melhores práticas globais, influenciando as políticas de moderação e promovendo transparência.

Essa governança reforça a responsabilização da empresa mesmo em contextos onde decisões judiciais são delicadas ou inexistentes, especialmente em crises políticas e eleitorais.

A Meta tem aprimorado políticas para remover conteúdos graves e ilícitos rapidamente, cortar a amplificação de conteúdos prejudiciais pagos ou impulsionados, envolver a educação do usuário para evitar penalidades severas em primeiras infrações, e colaborar com parceiros externos para responder eficazmente a danos emergentes.

A responsabilização das plataformas pode ocorrer sem decisão judicial quando há notificações extrajudiciais ou regras internas claras, assegurando a adequação das respostas frente à gravidade dos conteúdos.

Analise da integração das políticas da Meta com a Decisão do STF

O Supremo Tribunal Federal (STF) decidiu que o artigo 19 do Marco Civil da Internet (Lei 12.965/2014) é parcialmente inconstitucional. Esse artigo estabelece que os provedores de aplicações de internet só podem ser responsabilizados civilmente por danos decorrentes de conteúdos publicados por terceiros se descumprirem uma ordem judicial específica. A maioria dos ministros entendeu que essa regra não é mais adequada para garantir a proteção dos direitos fundamentais e da democracia.

A decisão do STF aponta claramente para um dever de cuidado dos provedores de internet em casos de propagação massiva de conteúdos ilícitos graves. A questão foi debatida no Recurso Extraordinário (RE) 1037396 (Tema 987 da repercussão geral), relatada pelo ministro Dias Toffoli, e no RE 1057258 (Temas 533), relatada pelo ministro Luiz Fux.

Segundo a decisão do STF os provedores de serviços de internet têm a responsabilidade de agir imediatamente para impedir a circulação de conteúdos que configurem crimes graves, conforme uma lista específica. Entre esses crimes estão:

- Atos antidemocráticos previstos no Código Penal, como incitação à violência e terrorismo doméstico;

- Crimes relacionados a terrorismo, incluindo preparatórios, conforme a Lei nº 13.260/2016;

- Atos de induzimento, incitação ou auxílio ao suicídio e automutilação, conforme o artigo 122 do Código Penal;

- Incitação à discriminação por raça, cor, etnia, religião, nacionalidade, orientação sexual ou identidade de gênero, incluindo condutas homofóbicas e transfóbicas, conforme a Lei nº 7.716/1989;

- Crimes contra mulheres motivados por gênero, abrangendo também conteúdos que promovam ódio às mulheres, conforme diversas leis específicas e artigos do Código Penal;

- Crimes sexuais contra pessoas vulneráveis, pornografia infantil e outros delitos graves contra crianças e adolescentes, conforme artigos do Código Penal e do Estatuto da Criança e do Adolescente;

- Tráfico de pessoas, conforme o artigo 149-A do Código Penal.

A falha em remover rapidamente esses conteúdos pode acarretar responsabilidade para os provedores, reforçando a importância do cumprimento rigoroso desse dever de cuidado na moderação online.

Cumprimento do Dever de Cuidado do STF pela Meta: Medidas e Desafios

Para respeitar a decisão do STF sobre o dever de cuidado em casos de circulação massiva de conteúdos ilícitos graves, conforme o rol taxativo mencionado, e analisando o Relatório do Conselho de 2024 a Meta poderia efetivamente em 2025 adotar medidas eficazes para aprimorar identificação e acelerar a remoção imediata desses conteúdos em suas plataformas.

Com efeito o Relatório Anual 2024 da Oversight Board da Meta indica que a empresa tem implementado vários mecanismos que podem contribuir para cumprir essa exigência, tais como:

- Resolução rápida de casos e remoção de conteúdos ilegais: A Meta segundo o Relatório Anual de 2024 aumentou a rapidez na resolução dos casos escalados, atingindo 81% das resoluções dentro de cinco dias em 2024, mesmo com o aumento do volume de conteúdo reportado.

- Decisões vinculantes e recomendações: A Oversight Board emite decisões vinculantes sobre conteúdos específicos, incluindo casos de violência, discurso de ódio e crimes sexuais, além de recomendações para melhorar políticas e práticas de moderação.

- Aprimoramento de políticas para conteúdos sensíveis: O Relatório Anual aponta por exemplo, atualização de políticas para permitir exceções que respeitam o discurso legítimo, como no caso do termo “shaheed”, e criou exceções para conteúdos que conscientizam sobre abuso sexual, mantendo o equilíbrio entre remoção e liberdade de expressão.

- Educação e prevenção em níveis iniciais: A implementação de exercícios educacionais para usuários na primeira infração ajuda a reduzir conteúdos impróprios recorrentes, prevenindo violações mais graves.

- Políticas uniformes e alinhadas a padrões internacionais: Em resposta às recomendações da Oversight Board, a Meta tem buscado harmonizar suas políticas entre Facebook, Instagram e Threads, garantindo maior clareza, consistência e respeito aos direitos humanos.

Portanto, analisando-se o Relatório a Meta poderá atender à decisão do STF ao continuar investindo em moderação eficiente e rápida, baseadas em políticas claras e em decisões técnicas e independentes, que permitem a remoção imediata de conteúdos ilícitos graves previstos na decisão, sem comprometer a liberdade de expressão e a transparência.

Isso inclui especial atenção aos conteúdos previstos no código penal brasileiro citados pelo STF, como discursos antidemocráticos, terrorismo, incitação à discriminação, crimes contra mulheres, crianças e adolescentes, e tráfico de pessoas.